Sam Altman, CEO van OpenAI, deed eind 2024 een opvallende uitspraak: volgens hem weet OpenAI hoe ze Artificial General Intelligence (AGI) moeten maken. Dat zou een flinke doorbraak zijn: met AGI wordt gedoeld op kunstmatige intelligentie die slimmer is dan de mens. Een technologie die zeker komt, menen twee Nederlandse AI-experts. Maar of dat ook al op zo’n korte termijn lukt, is nog maar de vraag.

“We zijn er nu zeker van dat we weten hoe we AGI kunnen bouwen zoals we dat traditioneel hebben begrepen”, schreef Altman eind 2024 op zijn persoonlijke blog. “We geloven dat we in 2025 de eerste AI-agenten ‘aan het werk’ kunnen zien gaan en de output van bedrijven wezenlijk kunnen zien veranderen.”

Altman is niet de enige die zulke grootse uitspraken doet. Demis Hassabis, medeoprichter en CEO van Google DeepMind, zegt in zijn profielbeschrijving op X dat hij aan AGI werkt. Google zelf schreef afgelopen februari bovendien dat AGI ‘scherper in beeld komt’. De focus ligt plots dus op deze nóg slimmere vorm van kunstmatige intelligentie (AI). Maar wat is AGI nu eigenlijk?

De definitie van AGI

De definitie van AGI staat niet helemaal vast. Hoewel we doorgaans spreken van een AI die intelligenter is dan de mens, is dat geen concrete definitie. Want wat is intelligentie? Hoe meet je dat? En wanneer is een AI-model intelligenter dan de mens?

Wat dr. Carlo van de Weijer, general manager van het Eindhoven AI Systems Institute van de Technische Universiteit Eindhoven, betreft, heeft AGI te maken met ‘doelgericht, adaptief denken en handelen’. Volgens hem is dat namelijk wat intelligentie inhoudt: op slimme wijze kunnen bepalen hoe je tot een bepaald doel komt. “Bij klassieke automatisering geef je een programma input en komt er output uit. Jij bepaalt hoe het tot die output komt. Het fundamentele verschil met AI is dat je dit systeem een input en een output geeft, en de machine daar zelf een programma bij gaat schrijven. Je weet dus niet precies hoe dat algoritme werkt”, legt hij uit. “Op het moment dat een AI op net zo’n intelligente manier zelf kan bepalen hoe het een bepaald doel bereikt als de mens dat kan, dan is het AGI.”

Dr. Jelle Zuidema, universitair hoofddocent op het gebied van AI en Natural Language Processing bij de Universiteit van Amsterdam, kijkt naar de cognitieve vaardigheden van AI, iets waar hij in zijn werk ook veel mee bezig is. Onder de cognitieve functies of vaardigheden van de mens verstaan we onder meer geheugen, taal en concentratie. Samen leiden dit soort functies ertoe dat mensen informatie en kennis kunnen opnemen en verwerken.

Op een aantal van deze gebieden is AI de mens al voorbij. “Computers kunnen al heel lang beter rekenen, wat we altijd zien als onderdeel van intelligentie. Computers kunnen al twintig jaar beter schaken, wat we als het toppunt van menselijke intelligentie zien. Ze kunnen sinds tien jaar beter Go spelen, wat de volgende grote uitdaging was. Nu zijn ze ook beter in vertalen en spraakherkenning. Dus op allerlei aspecten van intelligentie doen computers het al beter”, vertelt Zuidema. Hij hangt daarom een andere definitie van AGI aan: één AI-systeem dat álles kan, en dan ook nog op een hoger niveau dan de mens. “Dus je ontwikkelt niet meer een AI-model speciaal voor schaken en een ander voor vertalen. Je hebt één AI-systeem dat al die dingen kan en ook verbindingen tussen deze vaardigheden kan leggen. Dat algemene ervan, dat is de ‘G’ in AGI.”

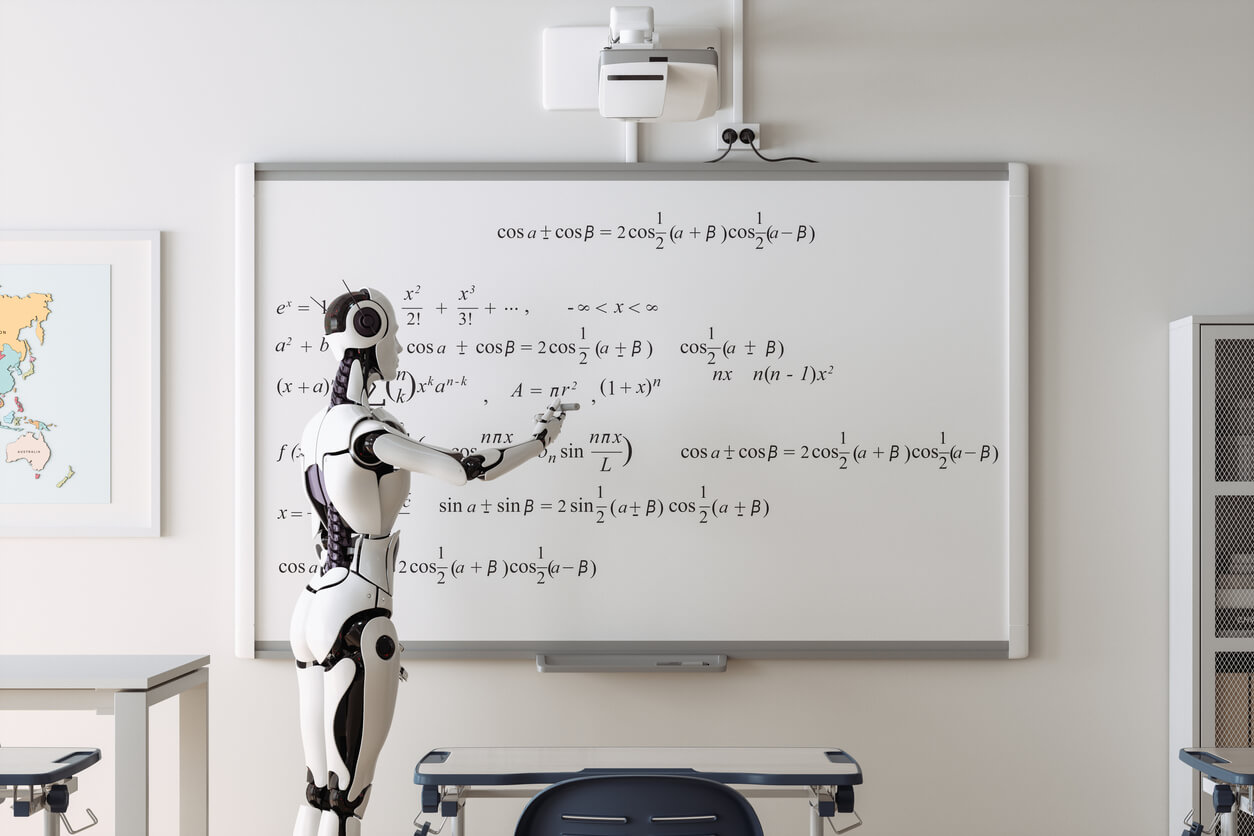

AI als wiskundedocent

Ook al bestaat AGI nog niet, de voordelen ervan zijn eenvoudig te bedenken. Een systeem dat net als de mens kan redeneren en functioneren, maar veel intelligenter is, kan immers voor veel toepassingen handig zijn. Zuidema noemt een AGI als wiskundedocent als voorbeeld: “Die moet de wiskunde snappen, maar ook de taal voldoende begrijpen om tegen de student te praten én een stukje sociale intelligentie hebben om goed te begrijpen hoe je met een student omgaat.”

Ook op het werk kan dit handig zijn: een AGI kan de mens als een soort extra collega ondersteunen in het werk, zodat de productiviteit van mensen hoger wordt. Van de Weijer ziet dergelijke situaties als zeer waarschijnlijk, omdat mensen en ‘machines’ –hulpmiddelen van het vuur dat onze voorouders ontdekten tot de computers die we nu gebruiken – al millennia samenwerken. “De mens is de sterkere soort omdat wij nu eenmaal machines hebben uitgevonden en we die steeds verder kunnen verbeteren. Wij kunnen het gebruik ervan aan elkaar leren en dit overgeven door generaties heen. En die machines hebben ons enorm veel productiever, rijker, welvarender en gezonder gemaakt. Maar dat proces van continue verbetering van onze leefomstandigheden door technologie moet je wel doorzetten. Mensen willen een soort illusie van vooruitgang zien.”

Goedbedoelde foutjes

Hoewel AGI er nog niet is, moeten we ons al wel vast buigen over de risico’s, vinden beide wetenschappers. “Je moet op de een of andere manier wel een moraal op deze machines kunnen projecteren”, zegt Van de Weijer stellig. “Het grootste risico is namelijk dat ze een opdracht verkeerd begrijpen. Als ik tegen een volledig zelfrijdende auto zeg ‘breng mij zo snel mogelijk naar huis’, dan kan de AI ook concluderen dat de snelste route dwars over een speelplein met spelende kinderen is. In feite is dat ook zo, maar het is natuurlijk niet de bedoeling dat je daar overheen rijdt.” Om dat soort scenario’s te voorkomen, moet er een vorm van een moreel kompas worden ingebouwd. Wat zijn de normen en waarden die wij als mensheid hanteren, die een AGI dus ook zou moeten handhaven? “Die ethiek wordt denk ik belangrijker dan het maken van de apparaten zelf.”

Zuidema is iets sceptischer over dit soort risico’s. “Het idee dat als we AGI bereiken, de AI ontsnapt aan de mens en we niet weten waar dat eindigt, daar kun je een leuke boom over opzetten. En ik denk dat het zeker interessant is om daar af en toe over na te denken”, zegt hij. Hij ziet echter een ander, reëler gevaar voor de korte termijn. “Dat kun je samenvatten als het gevaar dat mensen die met AI meer macht krijgen dan goed is voor ons als maatschappij. Dan denk ik aan wat er met behulp van deze sterk verbeterde AI-technologieën kan gebeuren. Wat een verzekeringsmaatschappij daarmee kan doen. Wat er in de machtsverhoudingen tussen overheden en burgers gebeurt. Tussen grote en kleine bedrijven of tussen Amerika en Europa. Dat soort verschuivingen in macht, daar moeten we het echt over hebben.”

AI wordt immers nu al gebruikt om gedrag en voorkeuren van mensen te voorspellen. “Dat stelt een relatief kleine club mensen in staat om andere mensen heel erg te manipuleren. Ze zijn van invloed in de marketingsfeer, hebben invloed op ons koopgedrag. Er zit een enorm machtsverschil tussen de mensen die met big data aan de knoppen zitten van die AI-technologie en de mensen die daar het onderwerp van zijn.”

Die risico’s inperken begint volgens Zuidema met bewustzijn, maar er is eigenlijk veel meer nodig. “Ik denk dat we al heel erg laat zijn met het aanpakken van deze economische monopolies. Daar moet fors op ingegrepen worden om dat in goede banen te leiden. En om te zorgen dat we AI-technologie ontwikkelen die onze gehele maatschappij ten goede komt, en niet alleen maar de paar spelers die op dit moment toegang hebben tot de data en de faciliteiten hebben om de beste modellen te trainen.”

Grote aankondiging over een jaar

Nu al met de komst van AGI bezig zijn, is dus van groot belang. Want dat AGI komt, dat staat wel vast, menen beide wetenschappers. “Dat is onvermijdelijk”, zegt Van de Weijer. “Systemen worden al sinds de ponskaart steeds intelligenter, met ongeveer een factor twee per anderhalf jaar. Ik zie geen enkele reden om te denken dat dat ooit stopt. Ik zou niet eens weten hoe je dat kunt stoppen.” De vraag is dus vooral wanneer AGI de markt op komt. En dat laat zich nog lastig voorspellen. “Ik ben verrast hoe snel die large language-modellen zich ontwikkeld hebben. En er komen steeds meer dingen bij die computers beter kunnen. Wanneer we het punt van AGI bereiken, is echt een kwestie van definitie.”

Ook Zuidema denkt dat AGI er wel komt. “Maar ik denk niet dat er één moment is waarop we AGI hebben. Dat is iets gradueels. Je kunt nu al over allerlei modellen roepen dat het AGI is”, concludeert hij. “Maar ik durf wel te voorspellen dat er tussen nu en ongeveer een jaar een aankondiging komt in Nature over een nieuwe AI-techniek die met behulp van een andere AI is ontdekt of ontwikkeld. Dat gaat men dan als mijlpaal proberen te marketen.”

Zuidema waarschuwt bovendien voor de grootse claims die nu gedaan worden, bijvoorbeeld door Sam Altman. “Vergeet niet dat Sam Altman er een onvoorstelbaar commercieel belang bij heeft dat wij denken dat AGI nu echt om de hoek is. Er zijn enorme bedragen in zijn bedrijf gestoken, dus ze moeten deze hype blijven voeden om hun positie te behouden.”